Più di 1.000 registrazioni audio dell’Assistente privato trapelano, ammette Google

Google è stato colto in un errore di privacy sulla raccolta vocale, con la società che ha ammesso che più di 1.000 registrazioni audio sono trapelate a un sito di notizie belga.

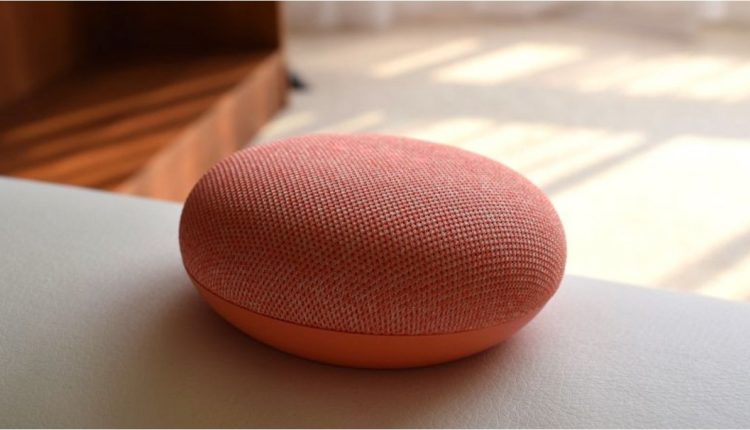

Come Amazon, Google ha un hub di lavoratori che ascoltano le domande dell'Assistente Google degli utenti per migliorare la sua intelligenza artificiale. Queste registrazioni dovrebbero rimanere anonime e, soprattutto, sicure sui server di Google.

Ma oltre 1.000 di queste registrazioni sono trapelate da un appaltatore all'emittente belga VRT NWS. Le registrazioni presumibilmente contengono informazioni sensibili inclusi gli indirizzi, secondo VRT. Per confermare che le registrazioni fossero reali, VRT "ha lasciato che i fiamminghi ordinari ascoltassero alcune delle loro registrazioni". Queste persone potrebbero confermare di aver sentito la propria voce nelle clip audio.

Sebbene la fuga di queste informazioni sia già abbastanza grave, 153 delle registrazioni erano conversazioni registrate senza che fosse pronunciata la parola d'ordine "Ok Google". Gli altoparlanti intelligenti di Google ascoltano queste parole di risveglio e dovrebbero iniziare a registrare qualsiasi cosa solo dopo che sono state pronunciate. Tra questi clip vocali c'erano conversazioni private, chiamate di lavoro e simili, che i partecipanti quasi certamente non volevano registrare.

Google ha ammesso la fuga di notizie in un post sul blog, in cui ha confermato che un revisore linguistico aveva violato le politiche di sicurezza dell'azienda e ha condiviso le registrazioni con VRT.

"I nostri team di risposta alla sicurezza e alla privacy sono stati attivati su questo problema, stanno indagando e prenderemo provvedimenti", ha affermato il product manager della ricerca di Google, David Monsees. "Stiamo conducendo una revisione completa delle nostre salvaguardie in questo spazio per evitare che si ripetano comportamenti scorretti come questo".

È l'ultimo di una serie di errori di sicurezza da parte delle compagnie telefoniche. Amazon è stata molto in prima pagina di recente per il modo in cui ha gestito le registrazioni di Alexa, con rapporti secondo cui non sta anonimizzando a sufficienza i dati.

Le aziende vocali utilizzano i lavoratori per ascoltare le registrazioni al fine di "addestrare" l'IA. È una pratica consolidata, ma di cui molti utenti non sono a conoscenza. E questo è del tutto giusto perché Google non dice che lo sta facendo nelle sue politiche sulla privacy.

OK, Google: è ora di essere più trasparenti con noi

Google ha difeso la pratica nel suo post sul blog, definendola una "parte fondamentale" del miglioramento dell'Assistente.

"Gli esperti di lingue esaminano solo circa lo 0,2 percento di tutti i frammenti audio", ha affermato Monsees. "Gli snippet audio non sono associati agli account utente come parte del processo di revisione e i revisori sono invitati a non trascrivere conversazioni in background o altri rumori e solo a trascrivere snippet indirizzati a Google".

Google ha anche riconosciuto ciò che chiama "false accettazioni" – momenti in cui l'Assistente pensa di aver sentito le parole di attivazione e avvia le registrazioni, quando in realtà il comando di attivazione non è mai stato dato. Questo potrebbe spiegare le 153 registrazioni non intenzionali, ma questo è un numero significativo in un campione di 1.000. Quindi estrapolalo e non è una buona occhiata. Inoltre, le politiche di Google affermano che solo le registrazioni previste vengono inviate a Google, il che chiaramente non è il caso.

Che cosa si può fare? Puoi disattivare la memorizzazione dei dati audio sul tuo account Google, se lo desideri, oppure puoi fare in modo che elimini automaticamente i tuoi dati ogni tre o 18 mesi. Google ha promesso che ci saranno "opportunità di revisione" per chiarire come vengono utilizzati i dati. A proposito di tempo anche.